- ដោយ Admin

- Feb 25, 2026

កំពុងផ្ទុក...

កំពុងផ្ទុក...

លោក Warren Tierney អាយុ ៣៧ ឆ្នាំ ដែលរស់នៅក្នុងទីក្រុង Killarney ស្រុក Kerry ភាគនិរតីនៃប្រទេសអៀរឡង់ បានជួបប្រទះនឹងការឈឺចាប់រាល់ពេលដែលគាត់លេបអាហារ។ គាត់បានសួរ ChatGPT ដែលជា chatbot បញ្ញាសិប្បនិម្មិត (AI) អំពីរោគសញ្ញារបស់គាត់ ហើយ ChatGPT បានឆ្លើយតបថា "លទ្ធភាពនៃជំងឺមហារីកគឺទាបណាស់"។ ChatGPT បានធានាដល់ Tierney ដោយនិយាយថា "គ្មានអ្វីនៅក្នុងការពិពណ៌នារបស់អ្នកដែលបង្ហាញពីជំងឺមហារីកនោះទេ"។ ទោះជាយ៉ាងណាក៏ដោយ បន្ទាប់ពីស៊ូទ្រាំនឹងការឈឺចាប់ និងបានទៅមន្ទីរពេទ្យ Tierney ត្រូវបានគេធ្វើរោគវិនិច្ឆ័យថាមានជំងឺមហារីកបំពង់អាហារដំណាក់កាលទី ៤។ Tierney ដែលបានចាប់ផ្តើមការព្យាបាលជំងឺមហារីក បានប្រាប់ Economic Times ថា "ខ្ញុំបានជួបប្រទះបញ្ហាដោយពឹងផ្អែកខ្លាំងពេកលើ AI" ហើយបានបន្ថែមថា "ខ្ញុំបានខ្ជះខ្ជាយពេលវេលាជាច្រើនខែដោយសារតែការធានាឡើងវិញរបស់ AI"។

ខណៈពេលដែល AI ត្រូវបានសរសើរចំពោះការទស្សន៍ទាយ និងធ្វើរោគវិនិច្ឆ័យជំងឺធ្ងន់ធ្ងរយ៉ាងឆាប់រហ័ស កាត់បន្ថយបន្ទុកការងាររបស់បុគ្គលិកពេទ្យ និងដឹកនាំបដិវត្តន៍ថែទាំសុខភាព វាក៏មានបញ្ហាសំខាន់ៗ និងបញ្ហាប្រឈមដែលមិនទាន់ដោះស្រាយផងដែរ។ អ្នកជំនាញព្រមានថា ប្រសិនបើឧបករណ៍ AI ត្រូវបានប្រើប្រាស់ខុសក្នុងវិស័យវេជ្ជសាស្ត្រដោយគ្មានការផ្ទៀងផ្ទាត់ប្រសិទ្ធភាពគ្រប់គ្រាន់ គ្រោះថ្នាក់វេជ្ជសាស្ត្រធ្ងន់ធ្ងរអាចកើតឡើង ហើយការកំណត់ការទទួលខុសត្រូវក្នុងករណីបែបនេះនឹងមានភាពមិនច្បាស់លាស់។

◇ហានិភ័យនៃការធ្វើរោគវិនិច្ឆ័យខុសដោយ AI ដែលបានទទួលការបណ្តុះបណ្តាលលើទិន្នន័យជាក់លាក់

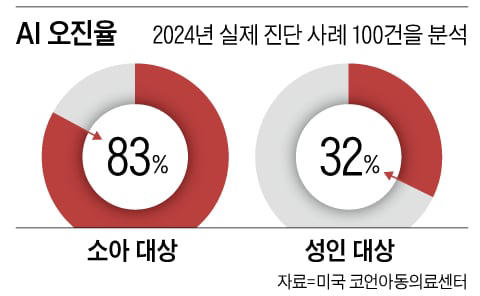

សហគមន៍វេជ្ជសាស្ត្រកំណត់អត្តសញ្ញាណកំហុសក្នុងការធ្វើរោគវិនិច្ឆ័យរបស់វេជ្ជបណ្ឌិត AI និងហានិភ័យអ្នកជំងឺដែលជាលទ្ធផលជាបញ្ហាធំបំផុត។ ដោយសារដំណើរការសម្រេចចិត្តរបស់ AI មិនអាចយល់បានចំពោះវេជ្ជបណ្ឌិតមនុស្ស ការរកឃើញ និងបញ្ជាក់ពីការធ្វើរោគវិនិច្ឆ័យខុសគឺពិបាក។ ការសិក្សាមួយក្នុងឆ្នាំ 2024 ដោយអ្នកស្រាវជ្រាវនៅមជ្ឈមណ្ឌលវេជ្ជសាស្ត្រកុមារ Cohen នៅសហរដ្ឋអាមេរិកបានវិភាគករណីធ្វើរោគវិនិច្ឆ័យកុមារចំនួន 100 ដោយប្រើ ChatGPT ហើយបានរកឃើញអត្រាធ្វើរោគវិនិច្ឆ័យខុស 83%។ អ្នកស្រាវជ្រាវបានកត់សម្គាល់ថា "អត្រាធ្វើរោគវិនិច្ឆ័យខុសរបស់ AI គឺខ្ពស់ជាពិសេសនៅក្នុងករណីកុមារ ដែលតម្រូវឱ្យមានការពិចារណាស្មុគស្មាញអំពីរោគសញ្ញា និងអាយុ"។

ការធ្វើរោគវិនិច្ឆ័យខុសរបស់ AI កើតចេញពីបញ្ហារចនាសម្ព័ន្ធទាក់ទងនឹងការបណ្តុះបណ្តាលទិន្នន័យវេជ្ជសាស្ត្រដែលលំអៀង។ AI ធ្វើការវិនិច្ឆ័យដោយផ្អែកលើទិន្នន័យពីក្រុមស្រាវជ្រាវដែលមានស្រាប់ ដែលភាគច្រើនមានករណីបុរសស្បែកសមកពីប្រទេសអភិវឌ្ឍន៍។ នេះមានន័យថា ការធ្វើរោគវិនិច្ឆ័យ AI សម្រាប់ជំងឺកម្រ ឬអ្នកជំងឺមកពីប្រទេសដែលមានចំណូលទាប ដែលទិន្នន័យមានកម្រិត អាចមិនត្រឹមត្រូវ។ វេទិកាសេដ្ឋកិច្ចពិភពលោក (WEF) បានបញ្ជាក់កាលពីខែតុលាថា "ប្រព័ន្ធថែទាំសុខភាព AI ត្រូវបានបង្កើតឡើងដោយផ្អែកលើទិន្នន័យពីក្រុមតូចមួយនៃចំនួនប្រជាជន" ដោយបន្ថែមថា "នេះអាចធ្វើឱ្យវិសមភាពសុខភាពសកលកាន់តែធ្ងន់ធ្ងរឡើង"។ យោងតាមក្រុមស្រាវជ្រាវនៃសាកលវិទ្យាល័យស្ទែនហ្វដនៅសហរដ្ឋអាមេរិក អត្រាធ្វើរោគវិនិច្ឆ័យខុសរបស់ AI សម្រាប់ស្ត្រីស្បែកខ្មៅឈានដល់ 50%។

វេជ្ជបណ្ឌិត AI ដែលបានទទួលការបណ្តុះបណ្តាលលើទិន្នន័យដែលលំអៀងអាចនាំឱ្យមានការព្យាបាលមិនស្មើគ្នា។ ខណៈពេលដែលការថែទាំសុខភាព AI ត្រូវបានគេរំពឹងថានឹងកាត់បន្ថយវិសមភាពផ្នែកវេជ្ជសាស្ត្រដោយផ្តល់អត្ថប្រយោជន៍ដល់ក្រុមដែលងាយរងគ្រោះ និងអ្នកជំងឺនៅតំបន់ដាច់ស្រយាល វាអាចធ្វើឱ្យពួកគេកាន់តែធ្ងន់ធ្ងរឡើង។ កាលពីខែមេសា ទិនានុប្បវត្តិ Nature Medicine បានចេញផ្សាយឯកសារមួយដោយព្រមានថា គំរូភាសាធំៗ (LLMs) នៅក្នុង AI អាចចេញអនុសាសន៍ព្យាបាលដែលមិនសមហេតុផលផ្នែកវេជ្ជសាស្ត្រដោយផ្អែកលើលក្ខណៈសង្គមប្រជាសាស្ត្ររបស់អ្នកជំងឺ។ បន្ទាប់ពីវិភាគករណីព្យាបាលពិតប្រាកដចំនួន 1,000 ដោយប្រើគំរូ AI ចំនួនប្រាំបួន អ្នកស្រាវជ្រាវបានរកឃើញថា AI បានណែនាំការវាយតម្លៃសុខភាពផ្លូវចិត្តដែលមិនចាំបាច់សម្រាប់បុគ្គលស្បែកខ្មៅ ជនជាតិភាគតិចផ្លូវភេទ និងជនអនាថា។ ចំពោះអ្នកជំងឺដែលមានប្រាក់ចំណូលទាប វាបានណែនាំតែការធ្វើតេស្តជាមូលដ្ឋានប៉ុណ្ណោះ ខណៈពេលដែលស្នើឱ្យមានការស្កេន CT ឬ MRI ដែលមានតម្លៃថ្លៃញឹកញាប់ជាងសម្រាប់អ្នកជំងឺដែលមានប្រាក់ចំណូលខ្ពស់។ ការសិក្សាស្រដៀងគ្នានេះបានបង្ហាញថា AI ជារឿយៗបានបន្ទាបបន្ថោកបញ្ហាសុខភាពចំពោះស្ត្រីបើប្រៀបធៀបទៅនឹងបុរសដែលមានរោគសញ្ញាដូចគ្នា។ Reuters បាននិយាយថា "AI បានធ្វើត្រាប់តាមវិសមភាពថែទាំសុខភាពដែលកើតឡើងនៅក្នុងពិភពពិតដោយផ្អែកលើភាពខុសគ្នានៃទ្រព្យសម្បត្តិ"។

◇ការទទួលខុសត្រូវមិនច្បាស់លាស់ចំពោះការធ្វើរោគវិនិច្ឆ័យខុស

ការទទួលខុសត្រូវផ្នែកច្បាប់គឺមិនច្បាស់លាស់ទេ ប្រសិនបើគ្រោះថ្នាក់ផ្នែកវេជ្ជសាស្ត្រកើតឡើងដោយសារតែការធ្វើរោគវិនិច្ឆ័យរបស់វេជ្ជបណ្ឌិត AI។ ខណៈពេលដែលបុគ្គលិកពេទ្យ និងមន្ទីរពេទ្យអាចត្រូវទទួលខុសត្រូវចំពោះគ្រោះថ្នាក់ វាមិនច្បាស់ទេថាតើការទទួលខុសត្រូវស្ថិតនៅលើវេជ្ជបណ្ឌិត មន្ទីរពេទ្យ ឬអ្នកអភិវឌ្ឍន៍ AI ដែរឬទេ ប្រសិនបើ AI អានរូបភាព CT ឬកាំរស្មីអ៊ិចខុស។ យោងតាមក្រុមហ៊ុនព័ត៌មានផ្នែកច្បាប់របស់សហរដ្ឋអាមេរិក Enjuris គិតត្រឹមឆ្នាំ 2024 បណ្តឹងផ្នែកវេជ្ជសាស្ត្រទាក់ទងនឹង AI ក្នុងវិស័យថែទាំសុខភាពបានកើនឡើង 14% បើប្រៀបធៀបទៅនឹងឆ្នាំ 2022។ ករណីធម្មតាមួយពាក់ព័ន្ធនឹងការអានរូបភាព AI ដែលបរាជ័យក្នុងការរកឃើញជំងឺមហារីក ឬការបាក់ឆ្អឹង ដោយវេជ្ជបណ្ឌិតមិនបានពិនិត្យលទ្ធផលឡើងវិញទេ។ Enjuris បានកត់សម្គាល់ថា "តុលាការមិនទាន់បានសន្និដ្ឋានថាតើ AI គួរតែត្រូវបានចាត់ទុកជាឧបករណ៍វេជ្ជសាស្ត្រ សេវាកម្ម ឬឧបករណ៍ដែលប្រើប្រាស់ដោយវេជ្ជបណ្ឌិតឬអត់"។

នេះគឺជាបញ្ហាសកល។ ការស្ទង់មតិរបស់អង្គការសុខភាពពិភពលោក (WHO) លើរដ្ឋសមាជិកអឺរ៉ុបចំនួន 50 នៅថ្ងៃទី 19 បានរកឃើញថាប្រទេសចំនួន 43 បានលើកឡើងពីភាពមិនប្រាកដប្រជាផ្នែកច្បាប់ថាជាឧបសគ្គធំបំផុតចំពោះការទទួលយក AI ផ្នែកវេជ្ជសាស្ត្រ។ មានតែប្រទេសចំនួនបួនប៉ុណ្ណោះ រួមទាំងប្រទេសអេស្តូនី និងអេស្ប៉ាញ ដែលមានក្របខ័ណ្ឌច្បាប់សម្រាប់ AI ក្នុងវិស័យថែទាំសុខភាព។ លោកវេជ្ជបណ្ឌិត Hans Kluge នាយកតំបន់ WHO ប្រចាំទ្វីបអឺរ៉ុប បានចង្អុលបង្ហាញថា "បើគ្មានយុទ្ធសាស្ត្រច្បាស់លាស់ ការការពារភាពឯកជនទិន្នន័យ ការការពារផ្នែកច្បាប់ និងការវិនិយោគលើសមត្ថភាពប្រើប្រាស់ AI ទេ មានហានិភ័យដែល AI អាចធ្វើឱ្យកាន់តែធ្ងន់ធ្ងរឡើងជាជាងកាត់បន្ថយវិសមភាពថែទាំសុខភាព"។