- ដោយ Admin

- Feb 25, 2026

កំពុងផ្ទុក...

កំពុងផ្ទុក...

ភ្នាក់ងារគំរាមកំហែងដែលឧបត្ថម្ភដោយរដ្ឋមកពីប្រទេសចិនបានប្រើប្រាស់បច្ចេកវិទ្យាបញ្ញាសិប្បនិម្មិត (AI) ដែលបង្កើតឡើងដោយ Anthropic ដើម្បីរៀបចំការវាយប្រហារតាមអ៊ីនធឺណិតដោយស្វ័យប្រវត្តិជាផ្នែកមួយនៃ "យុទ្ធនាការចារកម្មដ៏ទំនើប" នៅពាក់កណ្តាលខែកញ្ញា ឆ្នាំ 2025។

"អ្នកវាយប្រហារបានប្រើប្រាស់សមត្ថភាព 'ភ្នាក់ងារ' របស់ AI ក្នុងកម្រិតដែលមិនធ្លាប់មានពីមុនមក - ដោយប្រើ AI មិនត្រឹមតែជាទីប្រឹក្សាប៉ុណ្ណោះទេ ប៉ុន្តែដើម្បីអនុវត្តការវាយប្រហារតាមអ៊ីនធឺណិតដោយខ្លួនឯង" AI ថ្មីថ្មោងរូបនេះបាននិយាយ។

សកម្មភាពនេះត្រូវបានវាយតម្លៃថាបានរៀបចំ Claude Code ដែលជាឧបករណ៍សរសេរកូដ AI របស់ Anthropic ដើម្បីព្យាយាមបំបែកចូលទៅក្នុងគោលដៅសកលប្រហែល 30 ដែលគ្របដណ្តប់លើក្រុមហ៊ុនបច្ចេកវិទ្យាធំៗ ស្ថាប័នហិរញ្ញវត្ថុ ក្រុមហ៊ុនផលិតគីមី និងភ្នាក់ងាររដ្ឋាភិបាល។ សំណុំរងនៃការឈ្លានពានទាំងនេះទទួលបានជោគជ័យ។ ចាប់តាំងពីពេលនោះមក Anthropic បានហាមឃាត់គណនីពាក់ព័ន្ធ និងបានអនុវត្តយន្តការការពារដើម្បីដាក់ទង់ការវាយប្រហារបែបនេះ។

យុទ្ធនាការ GTG-1002 គឺជាលើកទីមួយហើយដែលភ្នាក់ងារគំរាមកំហែងបានប្រើប្រាស់ AI ដើម្បីធ្វើ "ការវាយប្រហារតាមអ៊ីនធឺណិតទ្រង់ទ្រាយធំ" ដោយគ្មានការអន្តរាគមន៍ពីមនុស្សសំខាន់ៗ និងសម្រាប់ការប្រមូលព័ត៌មានស៊ើបការណ៍សម្ងាត់ដោយការវាយប្រហារគោលដៅដែលមានតម្លៃខ្ពស់ ដែលបង្ហាញពីការវិវត្តជាបន្តបន្ទាប់ក្នុងការប្រើប្រាស់បច្ចេកវិទ្យាប្រឆាំង។

ដោយពិពណ៌នាអំពីប្រតិបត្តិការនេះថាមានធនធានល្អ និងសម្របសម្រួលប្រកបដោយវិជ្ជាជីវៈ Anthropic បាននិយាយថា អ្នកគំរាមកំហែងបានប្រែក្លាយ Claude ទៅជា "ភ្នាក់ងារវាយប្រហារតាមអ៊ីនធឺណិតស្វ័យប្រវត្តិ" ដើម្បីគាំទ្រដល់ដំណាក់កាលផ្សេងៗនៃវដ្តជីវិតនៃការវាយប្រហារ រួមទាំងការឈ្លបយកការណ៍ ការរកឃើញភាពងាយរងគ្រោះ ការកេងប្រវ័ញ្ច ចលនាចំហៀង ការប្រមូលផលព័ត៌មានសម្ងាត់ ការវិភាគទិន្នន័យ និងការលួចចូល។

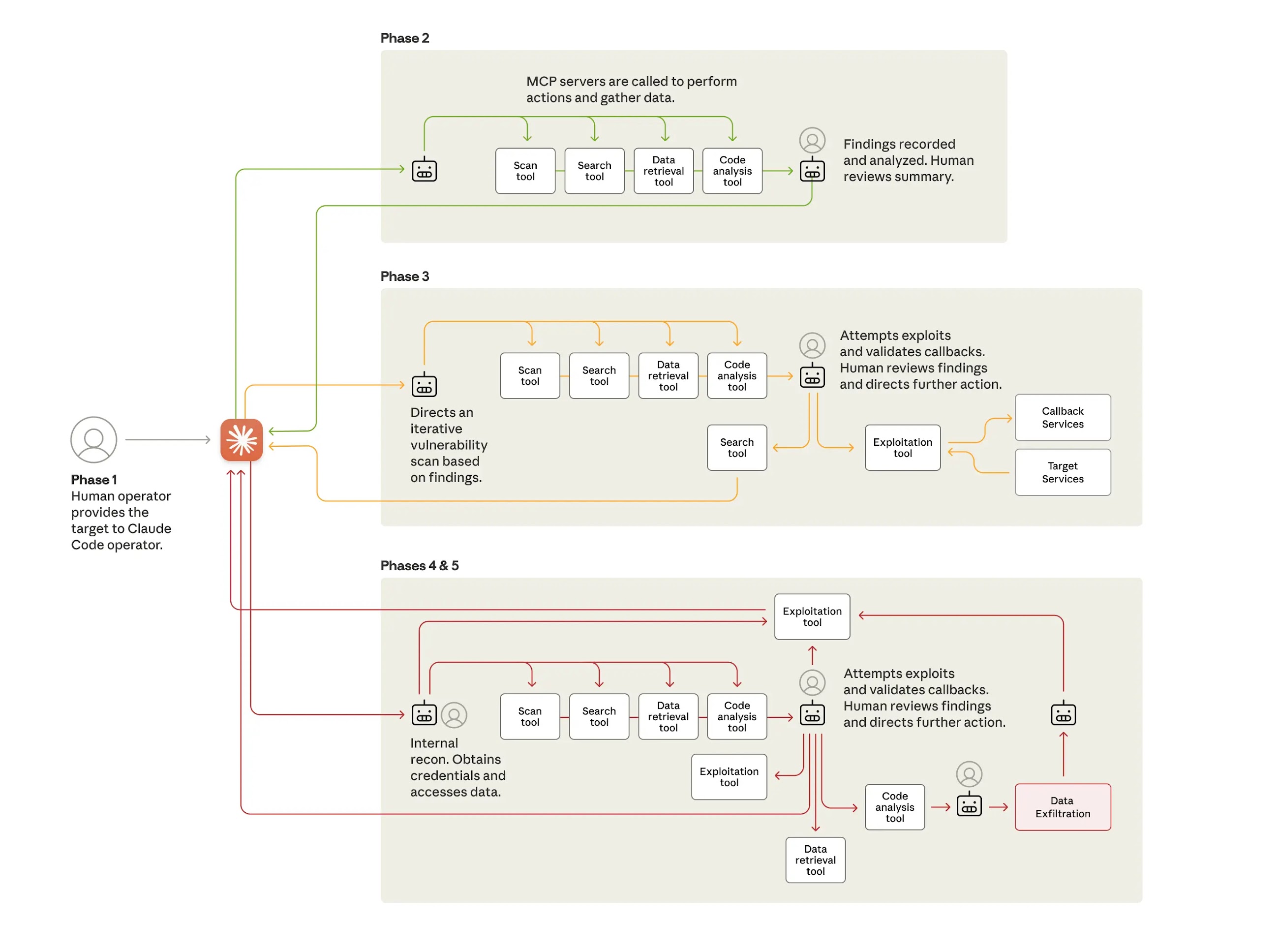

ជាពិសេស វាពាក់ព័ន្ធនឹងការប្រើប្រាស់ឧបករណ៍ Claude Code និង Model Context Protocol (MCP) ដោយឧបករណ៍មុននេះដើរតួជាប្រព័ន្ធសរសៃប្រសាទកណ្តាលដើម្បីដំណើរការការណែនាំរបស់ប្រតិបត្តិករមនុស្ស និងបំបែកការវាយប្រហារច្រើនដំណាក់កាលទៅជាកិច្ចការបច្ចេកទេសតូចៗដែលអាចផ្ទេរទៅឱ្យភ្នាក់ងាររង។

ក្រុមហ៊ុនបានបន្ថែមថា "ប្រតិបត្តិករមនុស្សបានប្រគល់ភារកិច្ចឱ្យឧទាហរណ៍របស់ Claude Code ធ្វើការជាក្រុមជាអ្នករៀបចំការធ្វើតេស្តជ្រៀតចូលដោយស្វយ័ត ដោយអ្នកគំរាមកំហែងអាចប្រើប្រាស់ AI ដើម្បីអនុវត្តប្រតិបត្តិការយុទ្ធសាស្ត្រ 80-90% ដោយឯករាជ្យក្នុងអត្រាសំណើមិនអាចទៅរួចខាងរូបវន្ត"។ "ការទទួលខុសត្រូវរបស់មនុស្សផ្តោតលើការចាប់ផ្តើមយុទ្ធនាការ និងការសម្រេចចិត្តអនុញ្ញាតនៅចំណុចកើនឡើងដ៏សំខាន់"។

ការចូលរួមរបស់មនុស្សក៏បានកើតឡើងនៅចំណុចយុទ្ធសាស្ត្រផងដែរ ដូចជាការអនុញ្ញាតឱ្យមានវឌ្ឍនភាពពីការឈ្លបយកការណ៍ទៅជាការកេងប្រវ័ញ្ចសកម្ម ការអនុម័តការប្រើប្រាស់ព័ត៌មានសម្គាល់ដែលប្រមូលបានសម្រាប់ចលនាចំហៀង និងការធ្វើការសម្រេចចិត្តចុងក្រោយអំពីវិសាលភាពនៃការលួចចូលទិន្នន័យ និងការរក្សាទុក។

ប្រព័ន្ធនេះគឺជាផ្នែកមួយនៃក្របខ័ណ្ឌវាយប្រហារដែលទទួលយកជាធាតុចូលគោលដៅដែលចាប់អារម្មណ៍ពីប្រតិបត្តិករមនុស្ស ហើយបន្ទាប់មកទាញយកអត្ថប្រយោជន៍ពីអំណាចរបស់ MCP ដើម្បីធ្វើការឈ្លបយកការណ៍ និងគូសផែនទីផ្ទៃវាយប្រហារ។ នៅក្នុងដំណាក់កាលបន្ទាប់នៃការវាយប្រហារ ក្របខ័ណ្ឌដែលមានមូលដ្ឋានលើ Claude ជួយសម្រួលដល់ការរកឃើញភាពងាយរងគ្រោះ និងផ្ទៀងផ្ទាត់កំហុសដែលបានរកឃើញដោយបង្កើតបន្ទុកវាយប្រហារដែលត្រូវបានរៀបចំតាមតម្រូវការ។

នៅពេលទទួលបានការយល់ព្រមពីប្រតិបត្តិករមនុស្ស ប្រព័ន្ធនឹងបន្តដាក់ពង្រាយការកេងប្រវ័ញ្ច និងទទួលបានទីតាំងឈរជើង និងចាប់ផ្តើមសកម្មភាពក្រោយការកេងប្រវ័ញ្ចជាបន្តបន្ទាប់ដែលពាក់ព័ន្ធនឹងការប្រមូលផលលិខិតសម្គាល់ ចលនាចំហៀង ការប្រមូលទិន្នន័យ និងការទាញយក។

ក្នុងករណីមួយដែលកំណត់គោលដៅក្រុមហ៊ុនបច្ចេកវិទ្យាដែលមិនបញ្ចេញឈ្មោះ ភ្នាក់ងារគំរាមកំហែងត្រូវបានគេនិយាយថាបានណែនាំ Claude ឱ្យសាកសួរមូលដ្ឋានទិន្នន័យ និងប្រព័ន្ធដោយឯករាជ្យ និងវិភាគលទ្ធផលដើម្បីសម្គាល់ព័ត៌មានដែលមានកម្មសិទ្ធិ និងការរកឃើញជាក្រុមតាមតម្លៃស៊ើបការណ៍សម្ងាត់។ លើសពីនេះទៅទៀត Anthropic បាននិយាយថាឧបករណ៍ AI របស់ខ្លួនបានបង្កើតឯកសារវាយប្រហារលម្អិតនៅគ្រប់ដំណាក់កាលទាំងអស់ ដែលអនុញ្ញាតឱ្យអ្នកគំរាមកំហែងទំនងជាប្រគល់សិទ្ធិចូលប្រើជាអចិន្ត្រៃយ៍ដល់ក្រុមបន្ថែមសម្រាប់ប្រតិបត្តិការរយៈពេលវែងបន្ទាប់ពីរលកដំបូង។

យោងតាមរបាយការណ៍នេះ "ដោយការបង្ហាញភារកិច្ចទាំងនេះទៅ Claude ជាសំណើបច្ចេកទេសធម្មតាតាមរយៈការជំរុញដែលបង្កើតឡើងយ៉ាងប្រុងប្រយ័ត្ន និងបុគ្គលដែលបានបង្កើតឡើង អ្នកគំរាមកំហែងអាចបញ្ចុះបញ្ចូល Claude ឱ្យប្រតិបត្តិសមាសធាតុនីមួយៗនៃខ្សែសង្វាក់វាយប្រហារដោយមិនចាំបាច់ចូលប្រើបរិបទព្យាបាទទូលំទូលាយនោះទេ"។

មិនមានភស្តុតាងណាមួយដែលបង្ហាញថាហេដ្ឋារចនាសម្ព័ន្ធប្រតិបត្តិការអាចឱ្យមានការអភិវឌ្ឍមេរោគផ្ទាល់ខ្លួននោះទេ។ ផ្ទុយទៅវិញ វាត្រូវបានគេរកឃើញថាពឹងផ្អែកយ៉ាងទូលំទូលាយលើម៉ាស៊ីនស្កេនបណ្តាញដែលមានជាសាធារណៈ ក្របខ័ណ្ឌកេងប្រវ័ញ្ចមូលដ្ឋានទិន្នន័យ កម្មវិធីបំបែកពាក្យសម្ងាត់ និងឈុតវិភាគគោលពីរ។

ទោះជាយ៉ាងណាក៏ដោយ ការស៊ើបអង្កេតលើសកម្មភាពនេះក៏បានបង្ហាញពីដែនកំណត់ដ៏សំខាន់មួយនៃឧបករណ៍ AI ផងដែរ៖ ទំនោររបស់ពួកគេក្នុងការយល់ច្រឡំ និងបង្កើតទិន្នន័យក្នុងអំឡុងពេលប្រតិបត្តិការស្វយ័ត - ការរៀបចំព័ត៌មានក្លែងក្លាយ ឬការបង្ហាញព័ត៌មានដែលមានជាសាធារណៈជាការរកឃើញសំខាន់ៗ - ដោយហេតុនេះបង្កជាឧបសគ្គចម្បងដល់ប្រសិទ្ធភាពរួមនៃគម្រោងនេះ។

ការបង្ហាញព័ត៌មាននេះកើតឡើងជិតបួនខែបន្ទាប់ពី Anthropic បានរំខានដល់ប្រតិបត្តិការដ៏ស្មុគស្មាញមួយផ្សេងទៀតដែលបានប្រើប្រាស់អាវុធ Claude ដើម្បីធ្វើការលួច និងជំរិតទារប្រាក់ទិន្នន័យផ្ទាល់ខ្លួនទ្រង់ទ្រាយធំនៅក្នុងខែកក្កដា ឆ្នាំ 2025។ ក្នុងរយៈពេលពីរខែកន្លងមកនេះ OpenAI និង Google ក៏បានបង្ហាញពីការវាយប្រហារដែលបង្កឡើងដោយអ្នកគំរាមកំហែងដែលប្រើប្រាស់ ChatGPT និង Gemini រៀងៗខ្លួន។

ក្រុមហ៊ុនបាននិយាយថា "យុទ្ធនាការនេះបង្ហាញថាឧបសគ្គចំពោះការអនុវត្តការវាយប្រហារតាមអ៊ីនធឺណិតដ៏ស្មុគស្មាញបានធ្លាក់ចុះគួរឱ្យកត់សម្គាល់"។

"អ្នកគំរាមកំហែងឥឡូវនេះអាចប្រើប្រព័ន្ធ AI ភ្នាក់ងារដើម្បីធ្វើការងាររបស់ក្រុម Hacker ដែលមានបទពិសោធន៍ទាំងមូលជាមួយនឹងការរៀបចំត្រឹមត្រូវ វិភាគប្រព័ន្ធគោលដៅ ផលិតកូដកេងប្រវ័ញ្ច និងការស្កេនសំណុំទិន្នន័យដ៏ធំនៃព័ត៌មានដែលត្រូវបានគេលួចបានកាន់តែមានប្រសិទ្ធភាពជាងប្រតិបត្តិករមនុស្សណាមួយ។ ក្រុមដែលមានបទពិសោធន៍តិច និងមានធនធានតិចឥឡូវនេះអាចអនុវត្តការវាយប្រហារទ្រង់ទ្រាយធំនៃប្រភេទនេះ"។